Loi du χ²

En statistiques et en théorie des probabilités, la loi du χ2 centrée (prononcé « khi carré » ou « khi-deux ») avec k degrés de liberté est la loi de la somme de carrés de k lois normales centrées réduites indépendantes.

| Loi du χ2 | |

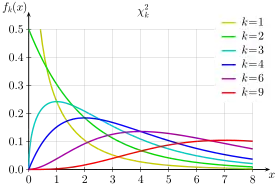

Densité de probabilité | |

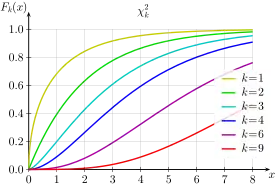

Fonction de répartition | |

| Paramètres | degrés de liberté |

|---|---|

| Support | |

| Densité de probabilité |

où est la fonction gamma |

| Fonction de répartition |

où est la fonction gamma incomplète |

| Espérance | |

| Médiane | |

| Mode | si |

| Variance | |

| Asymétrie | |

| Kurtosis normalisé | |

| Entropie | |

| Fonction génératrice des moments | pour |

| Fonction caractéristique | |

La loi du χ2 est utilisée en inférence statistique et pour les tests statistiques notamment le test du χ².

La loi du χ² non centrée généralise la loi du χ2.

Définition et caractéristiques

Définition

Soient k variables aléatoires X1, ... , Xk indépendantes suivant la loi normale centrée et réduite, c'est-à-dire la loi normale de moyenne 0 et d'écart-type 1. Alors par définition la variable X définie par

suit une loi du χ2 à k degrés de liberté. La loi de X est notée χ2 (k) ou χ 2

k.

Caractéristiques

La densité de probabilité de X notée fX est :

- pour tout x positif

où Γ est la fonction gamma[1].

Sa fonction de répartition est :

- où est la fonction gamma incomplète.

Approximation

Conformément au théorème central limite, lorsque k est « grand » (k > 100[2]), la loi d'une variable de χ2, somme de variables aléatoires indépendantes, peut être approchée par une loi normale d'espérance k et de variance 2k.

D'autres fonctions en χ2 peuvent converger plus rapidement vers la loi normale, notamment en ayant X~χ2(k) et k>30 :

- √2X - √2k-1 peut être approchée par une loi normale centrée réduite (approximation de Ronald Aylmer Fisher[3]).

- 3√X/k peut être approchée par une loi normale de moyenne 1-29k et de variance 29k (approximation de Wilson et Hilferty, 1931[4]).

- √X peut être approchée par (approximation de Hoaglin[5]).

Utilisation

Cette loi est principalement utilisée dans le test du χ2 basé sur la loi multinomiale pour vérifier l'adéquation d'une distribution empirique à une loi de probabilité donnée. Plus généralement elle s'applique dans le test d'hypothèses à certains seuils (indépendance notamment).

Elle est également utilisée pour établir des intervalles de confiance concernant la variance ou l'écart-type de variables aléatoires gaussiennes.

Histoire

Cette loi a été décrite pour la première fois par le géodésiste et statisticien allemand Friedrich Robert Helmert dans des articles de 1875–6,[6][7] où il a calculé la distribution d'échantillonnage de la variance de l'échantillon d'une population normale. Ainsi, en allemand, cela était traditionnellement connu sous le nom de Helmert'sche ("Helmertian") ou "distribution d'Helmert".

Cette loi a été redécouverte indépendamment par le mathématicien anglais Karl Pearson dans le contexte de la qualité de l'ajustement, pour lequel il a développé son test du χ² de Pearson, publié en 1900, avec une table calculée de valeurs publiées dans (Elderton 1902), recueillies dans (Pearson 1914, Table XII). Le nom "chi-carré" dérive finalement de la sténographie de Pearson pour l'exposant dans une loi normale multidimensionnelle avec la lettre grecque Chi, écrivant −½χ2 pour ce qui apparaîtrait dans la notation moderne comme −½xTΣ−1x' (Σ étant la matrice de covariance)[8].

L'idée d'une famille de "distributions du chi carré", cependant, n'est pas due à Pearson mais est apparue comme un développement ultérieur dû à Ronald Aylmer Fisher dans les années 1920[6].

Liens avec d'autres lois

Soient Xi des variables aléatoires indépendantes suivant des lois normales d'espérance μi et de variance σi2.

| Lois | en fonction de variables de loi normale |

|---|---|

| loi du χ2 | |

| Loi du χ2 non centrée | |

| Loi inverse-χ2 | |

| loi du χ | |

| loi du χ non centrée |

Si X est une variable aléatoire de loi normale centrée et réduite et Y suit une loi du χ2 à n degrés de liberté, X et Y étant indépendantes, alors suit une loi de Student à n degrés de liberté.

Si X suit une loi du χ2 à n degrés de liberté, et Y une loi du χ2 à m degrés de liberté, et si X et Y sont indépendantes, alors suit une loi de Fisher à n et m degrés de liberté.

Table de valeurs des quantiles

Le tableau suivant fournit les valeurs de certains quantiles de la loi du χ2 pour différents degrés de liberté k. Pour chaque valeur de α, le quantile donné est tel que la probabilité pour qu'une variable suivant une loi de χ2 à k degrés de liberté lui soit inférieur est de 1 – α. Par exemple, pour 1 – α = 0,95 et k = 7, si X suit une loi de χ2 à 7 degrés de liberté, on lit dans la table que

| Degrés de liberté | Valeur du χ2 | ||||||||||

|---|---|---|---|---|---|---|---|---|---|---|---|

| 1 | 0.004 | 0.02 | 0.06 | 0.15 | 0.46 | 1.07 | 1.64 | 2.71 | 3.84 | 6.63 | 10.83 |

| 2 | 0.10 | 0.21 | 0.45 | 0.71 | 1.39 | 2.41 | 3.22 | 4.61 | 5.99 | 9.21 | 13.82 |

| 3 | 0.35 | 0.58 | 1.01 | 1.42 | 2.37 | 3.66 | 4.64 | 6.25 | 7.81 | 11.34 | 16.26 |

| 4 | 0.71 | 1.06 | 1.65 | 2.20 | 3.36 | 4.88 | 5.99 | 7.78 | 9.49 | 13.28 | 18.47 |

| 5 | 1.14 | 1.61 | 2.34 | 3.00 | 4.35 | 6.06 | 7.29 | 9.24 | 11.07 | 15.09 | 20.52 |

| 6 | 1.63 | 2.20 | 3.07 | 3.83 | 5.35 | 7.23 | 8.56 | 10.64 | 12.59 | 16.81 | 22.46 |

| 7 | 2.17 | 2.83 | 3.82 | 4.67 | 6.35 | 8.38 | 9.80 | 12.02 | 14.07 | 18.48 | 24.32 |

| 8 | 2.73 | 3.49 | 4.59 | 5.53 | 7.34 | 9.52 | 11.03 | 13.36 | 15.51 | 20.09 | 26.12 |

| 9 | 3.32 | 4.17 | 5.38 | 6.39 | 8.34 | 10.66 | 12.24 | 14.68 | 16.92 | 21.67 | 27.88 |

| 10 | 3.94 | 4.87 | 6.18 | 7.27 | 9.34 | 11.78 | 13.44 | 15.99 | 18.31 | 23.21 | 29.59 |

| 11 | 4.57 | 5.58 | 6.99 | 8.15 | 10.3 | 12.9 | 14.6 | 17.3 | 19.7 | 24.7 | 31.3 |

| 12 | 5.23 | 6.30 | 7.81 | 9.03 | 11.3 | 14.0 | 15.8 | 18.5 | 21.0 | 26.2 | 32.9 |

| 13 | 5.89 | 7.04 | 8.63 | 9.93 | 12.3 | 15.1 | 17.0 | 19.8 | 22.4 | 27.7 | 34.5 |

| 14 | 6.57 | 7.79 | 9.47 | 10.8 | 13.3 | 16.2 | 18.2 | 21.1 | 23.7 | 29.1 | 36.1 |

| 15 | 7.26 | 8.55 | 10.3 | 11.7 | 14.3 | 17.3 | 19.3 | 22.3 | 25.0 | 30.6 | 37.7 |

| 1 – α | 0.05 | 0.1 | 0.2 | 0.3 | 0.5 | 0.7 | 0.8 | 0.9 | 0.95 | 0.99 | 0.999 |

Lien avec les méthodes bayésiennes

Dans son ouvrage Décisions rationnelles dans l'incertain (1974), qui constitue une somme des techniques bayésiennes dont la grande émergence se fait à cette époque, le professeur Myron Tribus montre que le χ2 constitue un exemple de passage à la limite du psi-test (test de plausibilité) bayésien lorsque le nombre de valeurs en présence devient grand - ce qui est la condition de travail des statistiques classiques, mais pas nécessairement des bayésiennes. Le raccord entre les deux disciplines, qui sont asymptotiquement convergentes, est ainsi complet.

L'ouvrage de référence de Jaynes en donne également une démonstration en page 287[9].

Voir aussi

Articles connexes

Notes et références

- La loi de X est un cas particulier de loi plus générale dite loi Gamma.

- (en) Eric J. Beh, « Exploring How to Simply Approximate the P-value of a Chi-Squared Statistic », Austrian Journal of Statistics, vol. 47, , p. 63–75 ([http://www.ajs.or.at/ doi:10.17713/ajs.v47i3.757 lire en ligne])

- (en) Ronald Aylmer Fisher, Statistical Methods for Research Workers, 2,

- (en) Edwin B. Wilson et Margaret M. Hilferty,, The distribution of Chi-square, Department of vital statistics, Harvard school of public health, , p. 687 (lire en ligne)

- (en) DC Hoaglin, « Approximations for Chi-squared Percentage Points », Journal of the American Statistical Association, vol. 2, , p. 508 – 515

- Hald 1998, 27. Distributions d'échantillonnage sous normalité, p. 633–692.

- Friedrich Robert Helmert, "Ueber die Wahrscheinlichkeit der Potenzsummen der Beobachtungsfehler und über einige damit im Zusammenhange stehende Fragen ", Zeitschrift für Mathematik und Physik 21, 1876, chapitre X, pp. 192–218

- (en) R. L. Plackett, « Karl Pearson and the Chi-Squared Test », International Statistical Review, vol. 51, no 1, , pp. 59-72 (JSTOR 1402731) Voir aussi Jeff Miller, Early Known Uses of Some of the Words of Mathematics.

- Introduction du livre

Bibliographie

- H. O. Lancaster (1969) The Chi-squared Distribution, New York: Wiley.

![\left[\sum_{i=1}^k \left(\frac{X_i-\mu_i}{\sigma_i}\right)^2\right]^{-1}](https://img.franco.wiki/i/ebdd461e8575fb3137cc4cfcad481f08d7f43907.svg)