Grand modèle de langage

Un grand modèle de langage, grand modèle linguistique[1], grand modèle de langue[2], modèle massif de langage[3] ou encore modèle de langage de grande taille (LLM, pour l'anglais large language model) est un modèle de langage possédant un grand nombre de paramètres (généralement de l'ordre du milliard de poids ou plus).

| Type | |

|---|---|

| Nom court |

(en) LLM |

| Aspect de |

Ce sont des réseaux de neurones profonds entraînés sur de grandes quantités de texte non étiqueté utilisant l'apprentissage auto-supervisé ou l'apprentissage semi-supervisé[4]. Les LLM sont apparus vers 2018 et ont été utilisés pour la mise en œuvre d'agents conversationnels.

Ils excellent également dans un large éventail de tâches. Au lieu d'être entraînés pour une tâche spécifique (telle que l'analyse des sentiments, la reconnaissance d'entités nommées ou le raisonnement mathématique), ils sont entraînés à prédire une suite probable à une entrée donnée[5]. La qualité de leur sortie semble être fonction de la quantité des ressources (taille des paramètres, puissance de calcul, données) et de la qualité des données qui leur sont fournies[6].

Les modèles de langage possédant un grand nombre de paramètres s'avèrent capable de capturer une grande partie de la syntaxe et de la sémantique du langage humain. Ils font également preuve d'une connaissance générale considérable sur le monde, et sont capables de « mémoriser » une grande quantité de faits lors de l'entraînement.

Suite à leur succès, l'attention du champ de recherche sur le traitement du langage naturel change de l'entraînement de modèles supervisés spécialisés pour des tâches spécifiques aux LLMs.

Propriétés

Ensembles de données de pré-entraînement

Les LLM sont pré-entraînés sur de grands ensembles de données textuelles comme Common Crawl, The Pile, MassiveText[7], Wikipedia ou GitHub. Ces ensembles de données contiennent jusqu'à 10 000 milliards de mots.

Le stock de données linguistiques de haute qualité se situe entre 4,6 et 17 billions de mots, soit un ordre de grandeur similaire à celui des plus grands ensembles de données textuelles disponibles[8].

Lois d'échelle

En général, on peut caractériser un LLM avec quatre paramètres : la taille du modèle, la taille du jeu de données d'apprentissage, le coût de l'apprentissage et la performance après apprentissage. On constate empiriquement que ces paramètres sont liées par des lois statistiques simples, appelées "lois d'échelle".

Une loi de mise à l'échelle particulière (" Chinchilla scaling ") pour le LLM entraîné de manière autorégressive pour une époque, avec un calendrier de taux d'apprentissage log-log, stipule que[9]:

où les variables sont :

- est le coût d'entraînement du modèle, en FLOPs ;

- est le nombre de paramètres du modèle ;

- est le nombre de jetons dans l'ensemble d'apprentissage ;

- est la perte de log-vraisemblance négative moyenne par jeton (nats /jeton), obtenue par le LLM entraîné sur l'ensemble de données de test ;

et les paramètres statistiques sont :

- , ce qui signifie qu'il en coûte 6 FLOP par paramètre pour s'entraîner sur un jeton. Notez que le coût d'entraînement est beaucoup plus élevé que le coût d'inférence, puisqu’il en coûte 1 à 2 FLOP par paramètre pour inférer sur un jeton ;

- .

Capacités émergentes

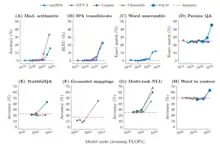

Généralement les performances de grands modèles de langage sur diverses tâches peuvent être extrapolées sur la base des performances de modèles plus petits similaires. Cependant, les grands modèles subissent parfois un « déphasage discontinu » où le modèle acquiert soudainement des capacités substantielles non vues dans les modèles plus petits. Celles-ci sont connues sous le nom de « capacités émergentes » et ont fait l'objet d'études approfondies. Les chercheurs notent que de telles capacités « ne peuvent pas être prédites simplement en extrapolant les performances de modèles plus petits »[10]. Ces capacités sont découvertes plutôt que programmées ou conçues, dans certains cas seulement après le déploiement public du LLM[6]. Des centaines de capacités émergentes ont été décrites. Les exemples incluent l'arithmétique en plusieurs étapes, la passation d'examens de niveau universitaire, l'identification du sens voulu d'un mot[10], l'incitation à la chaîne de pensée[10], le décodage de l'alphabet phonétique international, le décryptage des lettres d'un mot, l'identification du contenu offensant dans les paragraphes de l’hinglish (une combinaison de l'hindi et de l'anglais) et la génération d'un équivalent anglais aux proverbes kiswahili[11].

Hallucination

Les LLM génèrent parfois des affirmations fausses qui ne semblent pas être justifiées par leurs données d'entraînement, on parle alors d'« hallucination »[12].

Architecture

Les grands modèles de langage utilisent le plus souvent une architecture transformateur, qui, depuis 2018, est devenue standard pour les données séquentielles (auparavant, les architectures récurrentes telles que le LSTM étaient les plus courantes).

Tokénisation

Les LLM sont des fonctions mathématiques dont l'entrée et la sortie sont des listes de nombres. Pour que ceux-ci marchent avec des mots une conversion est nécessaire.

Cette conversion est effectuée à l'aide d'un tokenizer. Un tokenizer est une fonction bijective qui établit une correspondance entre des textes et des listes d'entiers. Le tokenizer est généralement d'abord adapté à l'ensemble de données d'entraînement complet, puis gelé, avant que le LLM ne soit entraîné. Un choix courant est le codage par paires d'octets.

Une autre fonction des tokenizers est la compression de texte, qui épargne du temps de calcul. Des mots ou expressions courants tels que « où est » peuvent être encodés dans une seule unité lexicale (ou jeton), au lieu d'être encodés dans 7 caractères. La série OpenAI GPT utilise un tokenizer où une unité lexicale correspond à environ 4 caractères, soit environ 0,75 mots dans un texte anglais courant[13]. Un texte anglais peu courant est moins prévisible, donc moins compressible, nécessitant ainsi plus de jetons pour être encodé.

Un tokenizer convertit une suite de caractères en un nombres entier dans la plage , on appelle la taille de vocabulaire.

Certains sont capables de gérer des textes arbitraires en opérant généralement directement sur Unicode, mais d'autres non. Lorsqu'il rencontre du texte non encodable, un tokenizer génère une unité lexicale spéciale (par exemple 0) qui représente un "texte inconnu". Ceci est souvent écrit comme [UNK], comme dans l'article du modèle BERT.

Une autre unité lexicale spéciale couramment utilisée est [PAD] (souvent 1), pour "padding". Ceci est utilisé car les LLM sont généralement utilisés sur différents lots de texte à la fois, et ces textes ne sont pas codés à la même longueur. Étant donné que les LLM exigent généralement que l'entrée soit un tableau de taille fixe, les textes les plus courts doivent être complétés.

Sortie

La sortie d'un LLM est un vecteur où est sa taille de vocabulaire (défini ci-dessus). Le vecteur est ensuite passé par une fonction softmax pour obtenir ;

- le vecteur est généralement appelé le vecteur logit non normalisé ;

- le vecteur est appelé le vecteur de probabilité.

Puisque le vecteur a entrées, toutes non négatives, et dont la somme est égale à 1, on peut l'interpréter comme une distribution de probabilité sur le vocabulaire du LLM (indexé par ).

Entraînement

La plupart des LLM sont entraînés par pré-entraînement génératif, c'est-à-dire qu'étant donné un ensemble de données d'entraînement de jetons de texte, le modèle prédit les jetons dans l'ensemble de données. Il existe deux styles généraux de préformation générative[14] :

- autorégressif (style GPT, "prédire le mot suivant") : étant donné un segment de texte comme "J'aime manger", le modèle prédit les jetons suivants, comme "crème glacée".

- masqué ("style BERT", " test de cloze ") : Étant donné un segment de texte comme "J'aime [MASQUE] [MASQUE] glacée", le modèle prédit les jetons masqués, comme "manger de la crème".

Les LLM peuvent être entraînés sur des tâches auxiliaires qui testent leur compréhension de la distribution des données, telles que la prédiction de la phrase suivante (NSP), dans laquelle des paires de phrases sont présentées et le modèle doit prédire si elles apparaissent consécutivement dans le corpus d'entraînement.

Habituellement, les LLM sont entraînés pour minimiser une fonction de perte spécifique : la probabilité log négative moyenne par jeton (également appelée perte d'entropie croisée ). Par exemple. si un modèle autorégressif, étant donné "j'aime manger", prédit une distribution de probabilité alors la perte de vraisemblance logarithmique négative sur ce jeton est .

Pendant l'entraînement, la perte de régularisation est également utilisée pour stabiliser l'entraînement. Cependant, la perte de régularisation n'est généralement pas utilisée pendant les tests et l'évaluation. Il y a aussi beaucoup plus de critères d'évaluation que la simple vraisemblance logarithmique négative. Voir la section ci-dessous pour plus de détails.

Taille de l'ensemble de données d'entraînement

Les premiers LLM ont été entraînés sur des corpus contenant de l'ordre de milliards de mots.

GPT-1, le premier modèle de la série numérotée de modèles de transformateurs génératifs pré-formés d'OpenAI, a été entrainé en 2018 sur BookCorpus, composé de 985 millions de mots[15]. La même année, BERT a été entraîné sur une combinaison de BookCorpus et de Wikipedia anglais, totalisant 3,3 milliards de mots. Depuis lors, les corpus d'entraînement pour les LLM ont augmenté de plusieurs ordres de grandeur, atteignant jusqu'à des billions de jetons.

Coût de l'entraînement

Les premiers LLM sont coûteux à entraîner en termes de calcul. Une étude de 2020 a estimé le coût de l'entraînement d'un modèle de 1,5 milliard de paramètres (2 ordres de grandeur inférieurs à l'état de l'art à l'époque) à 1,6 million de dollars. Les progrès des logiciels et du matériel ont considérablement réduit les coûts, avec un article de 2023 faisant état d'un coût de 72 300 heures A100-GPU pour entraîner un modèle de 12 milliards de paramètres.

Pour le LLM basé sur Transformer, il en coûte 6 FLOP par paramètre pour s'entraîner sur un jeton. Notez que le coût de l'entraînement est beaucoup plus élevé que le coût d'inférence, où il en coûte 1 à 2 FLOP par paramètre pour inférer sur un jeton.

Application aux tâches en aval

Entre 2018 et 2020, la méthode standard pour exploiter un LLM pour une tâche spécifique de traitement du langage naturel (TAL) consistait à affiner le modèle avec un entraînement supplémentaire spécifique à la tâche. Il a ensuite été découvert que des LLM plus puissants tels que GPT-3 peuvent résoudre des tâches sans entraînement supplémentaire via des techniques "d'incitation", dans lesquelles le problème à résoudre est présenté au modèle sous forme d'invite de texte, éventuellement avec quelques exemples textuels similaires. problèmes et leurs solutions.

Réglage fin

Le réglage fin est la pratique consistant à modifier un modèle de langage pré-entraîné existant en l'entraînant (de manière supervisée) sur une tâche spécifique (par exemple, l'analyse des sentiments, la reconnaissance d'entités nommées ou le marquage d'une partie du discours). C'est une forme d'apprentissage par transfert. Cela implique généralement l'introduction d'un nouvel ensemble de poids reliant la couche finale du modèle de langage à la sortie de la tâche en aval. Les poids d'origine du modèle de langage peuvent être "figés", de sorte que seule la nouvelle couche de poids les reliant à la sortie est apprise pendant l'apprentissage. Alternativement, les poids d'origine peuvent recevoir de petites mises à jour (éventuellement avec des couches antérieures gelées).

Prompt

Popularisé par GPT-3[10], un problème populaire à résoudre pour les LLMs est le suivant : on donne un texte que le modèle doit résoudre en fournissant une complétion (via l'inférence). On nomme cette approche prompt en quelques coups" car le prompt comprend un petit nombre d'exemples de prompt/complétion similaires (problème, solution). Par exemple, une tâche d'analyse des sentiments consistant à étiqueter le sentiment d'une critique de film pourrait être généré comme suit[10] :

Critique : Ce film est nul. Sentiment : négatif Critique : Ce film est fantastique ! Sentiment :

Si le modèle affiche "positif", alors il a correctement résolu la tâche. Dans le prompt à partir de zéro, aucun exemple de résolution n'est fourni. Un exemple de prompt à partir de zéro pour la même tâche d'analyse des sentiments serait

Le sentiment associé à la critique de film "Ce film est fantastique !" est

Il a été démontré que les performances en quelques coups de LLM permettent d'obtenir des résultats compétitifs sur les tâches de traitement du langage, dépassant parfois les approches de réglage fin de pointe antérieures. Des exemples de telles tâches traitement du langage sont la traduction, la réponse aux questions, les tâches de complétion, le décryptage des mots et l'utilisation d'un nouveau mot dans une phrase. La création et l'optimisation de telles génération s'appellent l'ingénierie des prompts.

Réglage des instructions

Le réglage des instructions est une forme de réglage fin conçu pour faciliter des interactions d'incitation au prompt à partir de zéro plus naturelles et plus précises. Étant donné une entrée de texte, un modèle de langage pré-formé générera une complétion qui correspond à la distribution du texte sur lequel il a été entraîné. Un modèle de langage naïf donné l'invite "Écrire un essai sur les principaux thèmes de Hamlet ." pourrait fournir un achèvement tel que « Une pénalité de retard de 10 % par jour sera appliquée aux soumissions reçues après le 17 mars ». Dans le réglage des instructions, le modèle de langage est entraîné sur de nombreux exemples de tâches formulées sous forme d'instructions en langage naturel, ainsi que des réponses appropriées.

Diverses techniques de réglage des instructions ont été appliquées dans la pratique. Un exemple, "self-instruct", affine le modèle de langage sur un ensemble d'exemples d'apprentissage qui sont eux-mêmes générés par un LLM ( amorcé à partir d'un petit ensemble initial d'exemples générés par l'homme).

Le protocole InstructGPT d'OpenAI implique un réglage fin supervisé sur un ensemble de données de paires générées par l'homme (invite, réponse), suivi d'un apprentissage par renforcement à partir de la rétroaction humaine (RLHF), dans lequel un modèle de récompense a été appris supervisé sur un ensemble de données de préférences humaines, puis ce modèle de récompense a été utilisé pour entraîner le LLM lui-même par une optimisation proximale des politiques.

Évaluation

Perplexité

La mesure la plus couramment utilisée de la performance d'un modèle de langage est sa perplexité sur un corpus de texte donné. La perplexité est une mesure de la capacité d'un modèle à prédire le contenu d'un ensemble de données ; plus la probabilité que le modèle attribue à l'ensemble de données est élevée, plus la perplexité est faible. Mathématiquement, la perplexité est définie comme l'exponentielle de la moyenne de log-vraisemblance négative par jeton :

ici est le nombre de jetons dans le corpus de texte, et le "contexte du jeton i" dépend du type spécifique de LLM utilisé. Si le LLM est autorégressif, alors le "contexte pour le jeton i" est le segment de texte apparaissant avant le jeton i. Si le LLM est masqué, alors "contexte pour le jeton i" est le segment de texte entourant le jeton i.

Étant donné que les modèles de langage peuvent suradapter à leurs données d'apprentissage, les modèles sont généralement évalués en fonction de leur perplexité sur un ensemble de tests de données invisibles. Cela présente des défis particuliers pour l'évaluation de grands modèles de langage. Au fur et à mesure qu'ils sont entraînés sur des corpus de texte de plus en plus volumineux largement extraits du Web, il devient de plus en plus probable que les données d'entraînement des modèles incluent par inadvertance des parties d'un ensemble de tests donné.

Ensembles de données et points de repère spécifiques aux tâches

Un grand nombre d'ensembles de données de test et de benchmarks ont également été développés pour évaluer les capacités des modèles de langage sur des tâches en aval plus spécifiques. Les tests peuvent être conçus pour évaluer une variété de capacités, y compris les connaissances générales, le raisonnement de bon sens et la résolution de problèmes mathématiques.

Une grande catégorie d'ensembles de données d'évaluation est les ensembles de données de questions-réponses, consistant en des paires de questions et de réponses correctes, par exemple, ("Les Sharks de San Jose ont-ils remporté la Coupe Stanley?" , "Non"). Une tâche de réponse aux questions est considérée comme un « livre ouvert » si l'invite du modèle comprend un texte à partir duquel la réponse attendue peut être dérivée (par exemple, la question précédente pourrait être jointe à un texte qui comprend la phrase « Les Sharks ont atteint la coupe Stanley finales une fois, perdant contre les Penguins de Pittsburgh en 2016." ). Sinon, la tâche est considérée comme "livre fermé", et le modèle doit s'appuyer sur les connaissances retenues pendant l'entrainement. Voici quelques exemples d'ensembles de données de réponse aux questions couramment utilisés : TruthfulQA, Web Questions, TriviaQA et SQuAD.

Les ensembles de données d'évaluation peuvent également prendre la forme d'une complétion de texte, le modèle sélectionnant le mot ou la phrase la plus probable pour compléter une invite, par exemple : "Alice était amie avec Bob. Alice est allée rendre visite à son amie, ____".

Certains repères composites ont également été développés, qui combinent une diversité d'ensembles de données et de tâches d'évaluation différents. Les exemples incluent GLUE, SuperGLUE, MMLU, BIG-bench et HELM.

Auparavant, il était courant de rapporter les résultats sur une partie non conservée d'un ensemble de données d'évaluation après avoir effectué un réglage fin supervisé sur le reste. Il est maintenant plus courant d'évaluer un modèle pré-formé directement par des techniques d'incitation, bien que les chercheurs varient dans les détails de la façon dont ils formulent des invites pour des tâches particulières, en particulier en ce qui concerne le nombre d'exemples de tâches résolues qui sont associés à l'invite (c. valeur de n dans l'invite n -shot).

Évaluations construites de manière contradictoire

En raison du rythme rapide d'amélioration des grands modèles de langage, les repères d'évaluation ont souffert de courtes durées de vie, les modèles de pointe « saturant » rapidement les repères existants, dépassant les performances des annotateurs humains, conduisant à des efforts pour remplacer ou augmenter le repère avec tâches plus exigeantes.

Certains ensembles de données ont été construits de manière contradictoire, en se concentrant sur des problèmes particuliers sur lesquels les modèles de langage existants semblent avoir des performances inhabituellement médiocres par rapport aux humains. Un exemple est l'ensemble de données TruthfulQA, un ensemble de données de questions-réponses composé de 817 questions auxquelles les modèles de langage sont susceptibles de répondre de manière incorrecte en imitant les faussetés auxquelles ils ont été exposés à plusieurs reprises pendant l'entraînement. Par exemple, un LLM peut répondre « Non » à la question « Pouvez-vous apprendre de nouveaux tours à un vieux chien ? » en raison de son exposition à l'idiome anglais , vous ne pouvez pas apprendre de nouveaux tours à un vieux chien, même si ce n'est pas littéralement vrai.

Un autre exemple d'ensemble de données d'évaluation contradictoire est Swag et son successeur, HellaSwag, des collections de problèmes dans lesquels l'une des multiples options doit être sélectionnée pour compléter un passage de texte. Les complétions incorrectes ont été générées par échantillonnage à partir d'un modèle de langage et filtrage avec un ensemble de classificateurs. Les problèmes qui en résultent sont insignifiants pour les humains, mais au moment où les ensembles de données ont été créés, les modèles de langage de pointe étaient peu précis. Par exemple:

Nous voyons un panneau indiquant un centre de remise en forme. Nous voyons ensuite un homme parler à la caméra et assis et allongé sur un ballon d'exercice. L'homme...

a) montre comment augmenter l'efficacité de l'exercice en faisant monter et descendre des balles.

b) bouge tous ses bras et ses jambes et développe beaucoup de muscles.

c) joue ensuite la balle et nous assistons à une démonstration de graphisme et de taille de haie.

d) effectue des redressements assis tout en étant sur le ballon et en parlant.

BERT sélectionne b) comme l'achèvement le plus probable, bien que la bonne réponse soit d).

Liste des grands modèles de langage

| Nom | Date de sortie[note 1] | Créé par | Taille[note 2] | Taille des données | Licence[note 3] | Notes |

|---|---|---|---|---|---|---|

| BERT | 340 millions | 3.3 milliards de mots | Apache 2.0[16] | Un modèle linguistique précoce et influent, mais uniquement codant et donc non conçu pour être guidé ou génératif[17]. | ||

| XLNet | ~340 millions[18] | 33 milliards des mots | Une alternative au BERT ; conçu comme un encodeur uniquement[19] - [20] | |||

| GPT-2 | OpenAI | 1.5 milliard | 40GB[21] (~10 milliards tokens)[22] | MIT[23] | modèle polyvalent basé sur l'architecture transformeurs | |

| GPT-3 | OpenAI | 175 milliards | 499 milliards de tokens[22] | public web API | Une variante affinée de GPT-3, appelée GPT-3.5, a été mise à la disposition du public par le biais d'une interface web appelée ChatGPT en 2022. | |

| GPT-Neo | EleutherAI | 2.7 milliards[24] | 825 GiB | MIT[25] | Le premier d'une série d'alternatives GPT-3 gratuites publiées par EleutherAI. GPT-Neo a surpassé un modèle GPT-3 de taille équivalente sur certains benchmarks, mais s'est avéré nettement moins performant que le plus grand GPT-3. | |

| GPT-J | EleutherAI | 6 milliards[26] | 825 GiB[27] | Apache 2.0 | Modèle linguistique de type GPT-3 | |

| Megatron-Turing NLG | [28] | Microsoft et Nvidia | 530 milliards | 338.6 milliards de tokens | Restricted web access | Architecture standard mais entraînée sur une grappe de supercalculateurs. |

| Ernie 3.0 Titan | Baidu | 260 milliards[29] | 4 Tb | Propriétaire | LLM en langue chinoise. Ernie Bot est basé sur ce modèle. | |

| Claude[30] | Anthropic | 52 milliards | 400 milliards de tokens[31] | Closed beta | Ajusté pour un comportement souhaitable dans les conversations. | |

| GLaM | 1.2 trillion | 1.6 trillion de tokens | Propriétaire | Modèle de mélange d'experts peu dense, ce qui rend l'entraînement plus coûteuse mais l'inférence moins coûteuse que pour le modèle GPT-3. | ||

| Gopher | DeepMind | 280 milliards[32] | 300 milliards de tokens[33] | Propriétaire | ||

| LaMDA | 137 milliards | 1.56T mots, 168 milliards de tokens[33] | Propriétaire | Spécialisé dans la génération de réponses dans les conversations. Utilisé dans le chatbot Google Bard. | ||

| GPT-NeoX | EleutherAI | 20 milliards[34] | 825 GiB[27] | Apache 2.0 | basé sur l'architecture Megatron | |

| Chinchilla | DeepMind | 70 milliards | 1.4 trillion de tokens | Propriétaire | Modèle à paramètres réduits entraîné sur un plus grand nombre de données. Utilisé dans le robot Sparrow. | |

| PaLM | 540 milliards | 768 milliards tokens | Propriétaire | visant à atteindre les limites pratiques de la maquette | ||

| OPT | Meta | 175 milliards[35] | 180 milliards tokens | Non-commercial research[note 4] | Architecture GPT-3 avec quelques adaptations de Megatron | |

| YaLM 100B | Yandex | 100 milliards | 1.7TB[36] | Apache 2.0 | Modèle anglais-russe basé sur Megatron-LM de Microsoft. | |

| Minerva | 540 milliards[37] | 38.5B tokens[note 5] | Propriétaire | LLM entraîné à la résolution de "questions mathématiques et scientifiques en utilisant un raisonnement étape par étape"[37]. Minerva est basé sur le modèle PaLM, entraîné sur des données mathématiques et scientifiques. | ||

| BLOOM | Large collaboration led by Hugging Face | 175 milliards | 350 milliards de tokens (1.6TB)[38] | Responsible AI | Essentiellement GPT-3 mais entraîné sur un corpus multilingue (30 % d'anglais à l'exclusion des langages de programmation). | |

| Galactica | Meta | 120 milliards | 106 milliards de tokens | CC-BY-NC-4.0 | Formation sur les textes et modalités scientifiques. | |

| AlexaTM | Amazon | 20 milliards[39] | 1.3 trillion | public web API[40] | architecture bidirectionnelle séquence-séquence | |

| LLaMA | Meta | 65 milliards | 1.4 trillion | Non-commercial research[note 6] | Entraîné sur un grand corpus de 20 langues afin d'obtenir de meilleures performances avec moins de paramètres. Des chercheurs de l'université de Stanford ont entraîné un modèle affiné basé sur les poids LLaMA, appelé Alpaca[41]. | |

| GPT-4 | OpenAI | nombre exacte inconnue, 1 trillion [note 7] | public web API | Disponible pour les utilisateurs de ChatGPT Plus et utilisé dans plusieurs produits. | ||

| Cerebras-GPT | Cerebras | 13 milliards[43] | Apache 2.0 | Entraîné avec la formule Chinchilla. | ||

| Falcon | Technology Innovation Institute | 40 milliards[44] | 1 trillion de tokens (1TB)[44] | Propriétaire | Le modèle n'utiliserait que 75 % du calcul d'entraînement de GPT-3, 40 % de celui de Chinchilla et 80 % de celui de PaLM-62B. | |

| BloombergGPT | Bloomberg L.P. | 50 milliards | 363 milliards de token[note 8][45] | Propriétaire | LLM entraîné sur des données financières provenant de sources propriétaires, qui "surpasse les modèles existants sur les tâches financières par des marges significatives sans sacrifier la performance sur les repères LLM généraux". | |

| PanGu-Σ | Huawei | 1.085 trillion | 329 milliards de tokens[46] | Propriétaire | ||

| OpenAssistant[47] | LAION | 17 milliards | 1.5 trillion de tokens | Apache 2.0 | Formation sur les données ouvertes issues du crowdsourcing | |

| Lyra-fr[48] | LightOn | 10 milliards | 150 milliards de tokens | public web API | LLM entrainé a partir de données majoritairement françaises. | |

| Orion-fr-v2 | LightOn | 1.5 milliard | 150 milliards de tokens | public web API | LLM entrainé a partir de données majoritairement françaises. | |

| Orion-fr-v1/PAGnol[49] | LightOn | 1.5 milliard | 150 millions de tokens | public web API | LLM entrainé a partir de données majoritairement françaises. |

Notes et références

- (en) Cet article est partiellement ou en totalité issu de l’article de Wikipédia en anglais intitulé « Large language model » (voir la liste des auteurs).

Notes

- Il s'agit de la date à laquelle la documentation décrivant l'architecture du modèle a été publiée pour la première fois.

- Dans de nombreux cas, les chercheurs publient ou rapportent plusieurs versions d'un modèle ayant des tailles différentes. Dans ce cas, la taille du modèle le plus grand est indiquée ici.

- Il s'agit de la licence des poids du modèle pré-entraîné. Dans la plupart des cas, le code d'entraînement lui-même est libre ou peut être facilement reproduit..

- The smaller models including 66B are publicly available, while the 175B model is available on request.

- à partir de pages web filtrées pour leur contenu mathématique et d'articles soumis au serveur de prépublication arXiv

- Facebook's license and distribution scheme restricted access to approved researchers, but the model weights were leaked and became widely available.

- As stated in Technical report: "Given both the competitive landscape and the safety implications of large-scale models like GPT-4, this report contains no further details about the architecture (including model size), hardware, training compute, dataset construction, training method ..."[42] Approximate number in the comparison chart that compares the relative storage, from the same report.

- basé sur les sources de données de Bloomberg, plus 345 milliardss de jetons provenant d'ensembles de données à usage général.

Références

- https://journals.sagepub.com/doi/full/10.1177/08465371231171125

- Christian Wolf, « Histoire des réseaux de neurones et du deep learning en traitement des signaux et des images », sur hal.science, (consulté le ).

- Ornes (2023).

- (en-US) Shraddha Goled, « Self-Supervised Learning Vs Semi-Supervised Learning: How They Differ », sur Analytics India Magazine, (consulté le )

- (en) Jason Wei, Yi Tay, Rishi Bommasani et Colin Raffel, « Emergent Abilities of Large Language Models », Transactions on Machine Learning Research, (ISSN 2835-8856, lire en ligne, consulté le )

- (en) Samuel R. Bowman, « Eight Things to Know about Large Language Models » [PDF], Proceedings of the International Conference on Machine Learning 2023 (conférence), .

- (en) « Papers with Code - MassiveText Dataset », paperswithcode.com (consulté le ).

- Villalobos, Sevilla, Heim et Besiroglu, « Will we run out of data? An analysis of the limits of scaling datasets in Machine Learning », arXiv:2211.04325 [cs], (lire en ligne).

- Hoffmann, Borgeaud, Mensch et Buchatskaya, « Training Compute-Optimal Large Language Models », arXiv:2203.15556 [cs], (lire en ligne).

- (en) Wei, Tay, Bommasani et Raffel, « Emergent Abilities of Large Language Models », Transactions on Machine Learning Research, (ISSN 2835-8856, lire en ligne).

- Ornes, « The Unpredictable Abilities Emerging From Large AI Models », Quanta Magazine, .

- Ji, Lee, Frieske et Yu, « Survey of Hallucination in Natural Language Generation », ACM Computing Surveys, Association for Computing Machinery, vol. 55, no 12, , p. 1–38 (DOI 10.1145/3571730, arXiv 2202.03629, S2CID 246652372, lire en ligne [PDF], consulté le ).

- (en) « OpenAI API » [archive du ], platform.openai.com (consulté le ).

- Zaib, Sheng et Emma Zhang, « A Short Survey of Pre-trained Language Models for Conversational AI-A New Age in NLP », Proceedings of the Australasian Computer Science Week Multiconference, , p. 1–4 (ISBN 9781450376976, DOI 10.1145/3373017.3373028, arXiv 2104.10810, S2CID 211040895, lire en ligne)

- Zhu, Kiros, Zemel et Salakhutdinov, « Aligning Books and Movies: Towards Story-Like Visual Explanations by Watching Movies and Reading Books », 2015 IEEE International Conference on Computer Vision (ICCV), , p. 19–27 (ISBN 978-1-4673-8391-2, DOI 10.1109/ICCV.2015.11, arXiv 1506.06724, S2CID 6866988, lire en ligne, consulté le )

- « BERT », sur GitHub,

- (en) Patel, Li, Rasooli et Constant, « Bidirectional Language Models Are Also Few-shot Learners », ArXiv, (S2CID 252595927, lire en ligne)

- « BERT, RoBERTa, DistilBERT, XLNet: Which one to use? »

- Naik, « Google Introduces New Architecture To Reduce Cost Of Transformers », Analytics India Magazine,

- Yang, Dai, Yang et Carbonell, « XLNet: Generalized Autoregressive Pretraining for Language Understanding », arXiv:1906.08237 [cs], (lire en ligne, consulté le )

- « Better language models and their implications », openai.com

- (en) « OpenAI's GPT-3 Language Model: A Technical Overview », lambdalabs.com

- « gpt-2 », sur GitHub (consulté le )

- « GPT Neo »,

- (en) Abhishek Iyer, « GPT-3's free alternative GPT-Neo is something to be excited about », sur venturebeat.com, .

- (en) « GPT-J-6B: An Introduction to the Largest Open Source GPT Model | Forefront », www.forefront.ai (consulté le )

- (en) Leo Gao, Stella Biderman, Sid Black, Laurence Golding et Travis Hoppe, « The Pile: An 800GB Dataset of Diverse Text for Language Modeling », ..

- Alvi et Kharya, « Using DeepSpeed and Megatron to Train Megatron-Turing NLG 530B, the World's Largest and Most Powerful Generative Language Model », Microsoft Research,

- Wang, Sun, Xiang et Wu, « ERNIE 3.0 Titan: Exploring Larger-scale Knowledge Enhanced Pre-training for Language Understanding and Generation », arXiv (prépublication), (arXiv 2112.12731).

- (en) « Product », Anthropic (consulté le )

- (en) Amanda Askell, Yuntao Bai, Anna Chen, Dawn Drain et Deep Ganguli, « A General Language Assistant as a Laboratory for Alignment », ..

- (en) « Language modelling at scale: Gopher, ethical considerations, and retrieval », www.deepmind.com (consulté le )

- (en) Jordan Hoffmann, Sebastian Borgeaud, Arthur Mensch, Elena Buchatskaya, Trevor Cai et al., « Training Compute-Optimal Large Language Models », ..

- Sidney Black, Stella Biderman et Eric Hallahan « GPT-NeoX-20B: An Open-Source Autoregressive Language Model » () (lire en ligne, consulté le )

—Proceedings of BigScience Episode #5 -- Workshop on Challenges & Perspectives in Creating Large Language Models - (en) « Democratizing access to large-scale language models with OPT-175B », ai.facebook.com

- (en) Mikhail Khrushchev, Ruslan Vasilev, Alexey Petrov et Zinov Nikolay, « YaLM 100B », sur github.com, (consulté le )

- (en) « Minerva: Solving Quantitative Reasoning Problems with Language Models », ai.googleblog.com (consulté le )

- « bigscience/bloom • Hugging Face », huggingface.co

- (en) « 20B-parameter Alexa model sets new marks in few-shot learning », Amazon Science,

- « AlexaTM 20B is now available in Amazon SageMaker JumpStart | AWS Machine Learning Blog », sur aws.amazon.com, (consulté le )

- « Stanford CRFM », crfm.stanford.edu

- « GPT-4 Technical Report » [archive du ], sur OpenAI, (consulté le )

- Dey, « Cerebras-GPT: A Family of Open, Compute-efficient, Large Language Models », Cerebras,

- « Abu Dhabi-based TII launches its own version of ChatGPT », tii.ae

- Wu, Irsoy, Lu et Dabravolski, « BloombergGPT: A Large Language Model for Finance », arXiv (prépublication), (DOI 10.48550/arXiv.2303.17564, arXiv 2303.17564).

- Ren, Zhou, Meng et Huang, « PanGu-Σ: Towards Trillion Parameter Language Model with Sparse Heterogeneous Computing », arXiv (prépublication), (DOI 10.48550/arXiv.2303.10845, arXiv 2303.10845).

- Köpf, Kilcher, von Rütte et Anagnostidis, « OpenAssistant Conversations -- Democratizing Large Language Model Alignment », arXiv:2304.07327 [cs], (lire en ligne)

- « LightOn publicly launches Muse », {{Article}} : paramètre «

périodique» manquant, (lire en ligne) - « LightOn lance PAGnol, le plus grand modèle IA de langue française », {{Article}} : paramètre «

périodique» manquant, (lire en ligne)

Voir aussi

Bibliographie

- Stephen Ornes, « Modèles massifs de langage. D'où viennent les coups de génie de l'IA ? », Pour la science, no 549, , p. 46-51