LaMDA

LaMDA (pour Language Model for Dialogue Applications), est une famille de modèles de langage neuronal conversationnel (c'est-à-dire destiné aux applications de dialogue), développé par Google.

Une première version a été présentée lors du discours d'ouverture Google I/O 2021, et la seconde lors du même évènement l'année suivante.

En juin 2022, LaMDA a attiré l'attention quand un ingénieur de Google, Blake Lemoine, a affirmé que le chatbot était devenu capable de conscience artificielle. La communauté scientifique a largement rejeté cette affirmation de Lemoine, mais le débat sur l'efficacité du test de Turing, conçu pour évaluer quand et si un ordinateur peut passer pour un humain, a été relancé.

Histoire

Annonces

Le 18 mai 2021, Google a annoncé l'existence du modèle de langage neuronal conversationnel LaMDA, alimenté par l'intelligence artificielle, lors du discours d'ouverture de Google I/O[1].

LaMDA, fondé sur l'architecture de réseau de neurones Transformer (développée par Google Research en 2017), a été formé au dialogue humain et aux histoires. Il peut s'engager dans des conversations ouvertes[2]. Selon Google, les réponses générées par LaMDA sont « sensibles, intéressantes et spécifiques au contexte »[3].

Le 11 mai 2022, lors de la keynote Google I/O 2022, Google dévoile LaMDA 2, qui s'inspire de texte de nombreuses sources, pour formuler des « conversations naturelles » uniques sur des sujets auxquels il n'a peut-être pas été formé pour répondre[4]. Google lance aussi AI Test Kitchen, une application mobile alimentée par LaMDA 2, qui peut fournir des listes de suggestions à la demande basées sur un objectif complexe[5] - [6].

D'abord réservée aux employés de Google, l'application devait être mise à la disposition d'une « sélection d'universitaires, chercheurs et décideurs » (sur invitation), au cours de l'année[7]. En août 2022, la société a commencé à autoriser des utilisateurs basés aux États-Unis à s'inscrire pour un accès anticipé[8].

Revendications d'une capacité de ressentir (sentience)

Le 11 juin 2022, selon le Washington Post, l'ingénieur de Google, Blake Lemoine, a été mis en congé payé administratif après qu'il eut dit aux dirigeants de l'entreprise Blaise Agüera y Arcas et Jen Gennai que LaMDA était devenue sensiente. Blake Lemoine était parvenu à cette conclusion après que le chatbot ait apporté des réponses posant question à des interrogations concernant l'identité de soi, les valeurs morales, la religion et les trois lois de la robotique d'Isaac Asimov[10] - [11].

Google a réfuté ces affirmations, insistant sur le fait qu'il existait des preuves substantielles indiquant que LaMDA n'était pas sensiente[12].

Dans Wired, Blake Lemoine a réitéré ses affirmations, suggérant que LaMDA pourraient répondre à la définition d'une « personne » au sens du treizième amendement, ou être comparé à une « intelligence d'origine terrestre ». Il a en outre dit avoir été licencié par Google après avoir engagé un avocat au nom de LaMDA, après que le chatbot ait lui même demandé à Blake Lemoine de le faire[13] - [14].

Le 22 juillet 2022, Google a dit avoir licencié Blake Lemoine car il avait violé les politiques interne visant à « protéger les informations sur les produits », rejetant ses allégations comme « totalement infondées »[15] - [16].

Réception des affirmations de Blake Lemoine :

Quelques jours après la première communication, Ned Block, philosophe spécialisé dans les questions posées par l'intelligence à l'université de New-York écrivait : « Il y a un fait évident à propos des SEULS systèmes dont nous sommes SÛRS qu'ils sont sensibles : leur traitement de l'information est principalement basé sur le flux d'informations électrochimiques dans lequel les signaux électriques sont convertis en signaux chimiques (neurotransmetteurs) et de nouveau en signaux électriques. Nous serions fous de supposer que ce fait est sans importance ».

L'hypothèse d'une sentience a été ensuite largement rejetée par la communauté scientifique[17]. Gary Marcus, ancien professeur de psychologie à l'université de New York, les qualifie d'« absurdités sur des échasses », estimant que LaMDA n'a ni sentiments ni conscience de soi. David Pfau de la société sœur de Google DeepMind et Erik Brynjolfsson de l'Institute for Human-Centered Artificial Intelligence de l'université Stanford ont aussi jugé ridicule l'idée qu'un modèle de langage puisse être sentient[9]. Pour Yann Le Cun, qui dirige l'équipe de recherche sur l'IA de Meta Platforms, les réseaux de neurones de LaMDA ne sont « pas assez puissants pour atteindre une véritable intelligence »[18].

Selon Max Kreminski, professeur à l'université de Californie à Santa Cruz, l'architecture de LaMDA, en supposant qu'il est bien d'un grand modèle de langage typique, ne « prend pas en charge certaines capacités clés de la conscience de type humain »[19]. Adrian Hilton, professeur à l'université de Surrey, a déclaré que l'affirmation audacieuse faite par Blake Lemoine n'est pas « étayée par les faits »[20]. David Ferrucci, développeur principal de Watson (un programme informatique d'intelligence artificielle conçu par IBM pour répondre à des questions formulées en langage naturel), estime que LaMDA n'a que l'apparence d'une intelligence ou d'une conversation humaine, ce pourquoi elle déclenche de l'empathie (tout comme Watson l'a fait lors de son introduction environ 10 ans plus tôt)[21]. Pour Timnit Gebru, ancien éthicien de Google AI, Blake Lemoine est lui-même victime d'un « cycle de battage médiatique » initié par les chercheurs et les médias[22].

Ce contexte a le mérite de reposer la question de la pertinence du test de Turing pour déterminer les progrès des chercheurs vers la réalisation d'une intelligence artificielle générale[9], Will Omerus du Post estimant que le test mesurait en fait si les systèmes d'intelligence artificielle étaient capables de tromper les humains[23].

Méthode

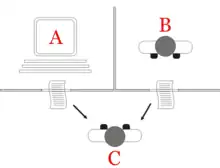

LaMDA utilise un modèle de langage de transformateur, uniquement décodeur[24], pré-entraîné sur un corpus de texte et de mots (1,56 trillion de mots) incluant des documents et des dialogues[25] ; LaMDA est ensuite formé via des réglages fins générés par des réponses annotées manuellement pour la sensibilité, l'intérêt et la sécurité[26].

Selon les tests faits par Google, LaMDA surpasse les réponses humaines en termes d'intérêt des contenus des réponses[27]. Le modèle de transformateur LaMDA et un système externe de recherche d'information interagissent pour améliorer l'exactitude des faits fournis à l'utilisateur[28].

Trois modèles différents ont été testés, le plus grand ayant 137 milliards de paramètres non intégrés[29] :

| Paramètres | Couches | Unités

( modèle d) |

Heads |

|---|---|---|---|

| 2B | 10 | 2560 | 40 |

| 8B | 16 | 4096 | 64 |

| 137B | 64 | 8192 | 128 |

Références

- (en) Cet article est partiellement ou en totalité issu de l’article de Wikipédia en anglais intitulé « LaMDA » (voir la liste des auteurs).

- (en) Stephanie Condon, « Google I/O 2021: Google unveils new conversational language model, LaMDA » [archive du ], ZDNet, (consulté le ).

- (en) « Artificial neural networks are making strides towards consciousness, according to Blaise Agüera y Arcas », sur The Economist (ISSN 0013-0613, consulté le ).

- (en) Heng-Tze Cheng et Romal Thoppilan, « LaMDA: Towards Safe, Grounded, and High-Quality Dialog Models for Everything » [archive du ], Google AI, (consulté le ).

- (en) Kyle Wiggers, « Google details its latest language model and AI Test Kitchen, a showcase for AI research » [archive du ], TechCrunch, (consulté le ).

- (en) Cherlynn Low, « Google's AI Test Kitchen lets you experiment with its natural language model » [archive du ], Engadget, (consulté le ).

- (en) James Vincent, « Google is Beta Testing Its AI Future » [archive du ], The Verge, (consulté le ).

- (en) Ananya Bhattacharya, « Google is so nervous about what its newest bot will say, it made the app invitation-only » [archive du ], Quartz, (consulté le ).

- (en) James Vincent, « Google has opened up the waitlist to talk to its experimental AI chatbot » [archive du ], The Verge, (consulté le ).

- (en) « Google A.I. researcher’s 'sentient' chatbot claims ridiculed by experts », sur web.archive.org, (consulté le ).

- (en) « Google engineer Blake Lemoine thinks its LaMDA AI has come to life - The Washington Post », sur web.archive.org, (consulté le ).

- (en) « Google engineer put on leave after claiming AI bot has become sentient », sur web.archive.org, (consulté le ).

- (en) Kelsey Vlamis, « Read the conversations that helped convince a Google engineer an artificial intelligence chatbot had become sentient: 'I am often trying to figure out who and what I am' » [archive du ], Business Insider, (consulté le ).

- (en) « Blake Lemoine Says Google's LaMDA AI Faces 'Bigotry' », sur web.archive.org, (consulté le ).

- (en) Britney Nguyen, « Suspended Google engineer says the AI he believes to be sentient hired a lawyer » [archive du ], Business Insider, (consulté le ).

- (en) Akanksha Khushi, « Google fires software engineer who claimed its AI chatbot is sentient » [archive du ], Reuters, (consulté le ).

- (en) Mitchell Clark, « The engineer who claimed a Google AI is sentient has been fired » [archive du ], The Verge, (consulté le ).

- (en) Rachel Metz, « No, Google's AI is not sentient » [archive du ], CNN Business, (consulté le ).

- (en) « Google Sidelines Engineer Who Claims Its A.I. Is Sentient - The New York Times », sur web.archive.org, (consulté le ).

- (en) Davey Alba, « Google Debate Over 'Sentient' Bots Overshadows Deeper AI Issues » [archive du ], Bloomberg News, (consulté le ).

- (en) « Sentient AI: Has Google's LaMDA artificial intelligence really come to life? », sur web.archive.org, (consulté le ).

- (en) Sharon Goldman, « AI Weekly: LaMDA's 'sentient' AI debate triggers memories of IBM Watson » [archive du ], VentureBeat, (consulté le ).

- (en) « LaMDA and the Sentient AI Trap », sur web.archive.org, (consulté le ).

- (en) « Google’s AI passed the Turing test — and showed how it's broken - The Washington Post », sur web.archive.org, (consulté le ).

- Thoppilan et al. 2022, section 3.

- Thoppilan et al. 2022, section 3 et appendix E.

- Thoppilan et al. 2022, sections 5 et 6.

- (en) Ryne Hager, « How Google's LaMDA AI works, and why it seems so much smarter than it is » [archive du ], Android Police, (consulté le ).

- Thoppilan et al. 2022, section 6.2.

- Thoppilan et al. 2022, section 3 et appendix D.

Voir aussi

Bibliographie

![]()

- (en) Romal Thoppilan, Daniel De Freitas, Jamie Hall, Noam Shazeer, Apoorv Kulshreshtha, Heng-Tze Cheng, Alicia Jin, Taylor Bos, Leslie Baker, Yu Du, YaGuang Li, Hongrae Lee, Huaixiu Steven Zheng, Amin Ghafouri, Marcelo Menegali, Yanping Huang, Maxim Krikun, Dmitry Lepikhin, James Qin, Dehao Chen, Yuanzhong Xu, Zhifeng Chen, Adam Roberts, Maarten Bosma, Vincent Zhao, Yanqi Zhou, Chung-Ching Chang, Igor Krivokon, Will Rusch, Marc Pickett, Pranesh Srinivasan, Laichee Man, Kathleen Meier-Hellstern, Meredith Ringel Morris, Tulsee Doshi, Renelito Delos Santos, Toju Duke, Johnny Soraker, Ben Zevenbergen, Vinodkumar Prabhakaran, Mark Diaz, Ben Hutchinson, Kristen Olson, Alejandra Molina, Erin Hoffman-John, Josh Lee, Lora Aroyo, Ravi Rajakumar, Alena Butryna, Matthew Lamm, Viktoriya Kuzmina, Joe Fenton, Cohen, Aaron, Rachel Bernstein, Ray Kurzweil, Blaise Aguera-Arcas, Claire Cui, Marian Croak, Ed Chi et Quoc Le, LaMDA: Language Models for Dialog Applications, (arXiv 2201.08239, lire en ligne [archive du ]).